💡 Tip. 바쁜 현대인들을 위한 본문 요약

- Perplexity AI 사용법의 핵심은 '답변+인용' 구조 — ChatGPT의 '답변만'과 결정적으로 다름

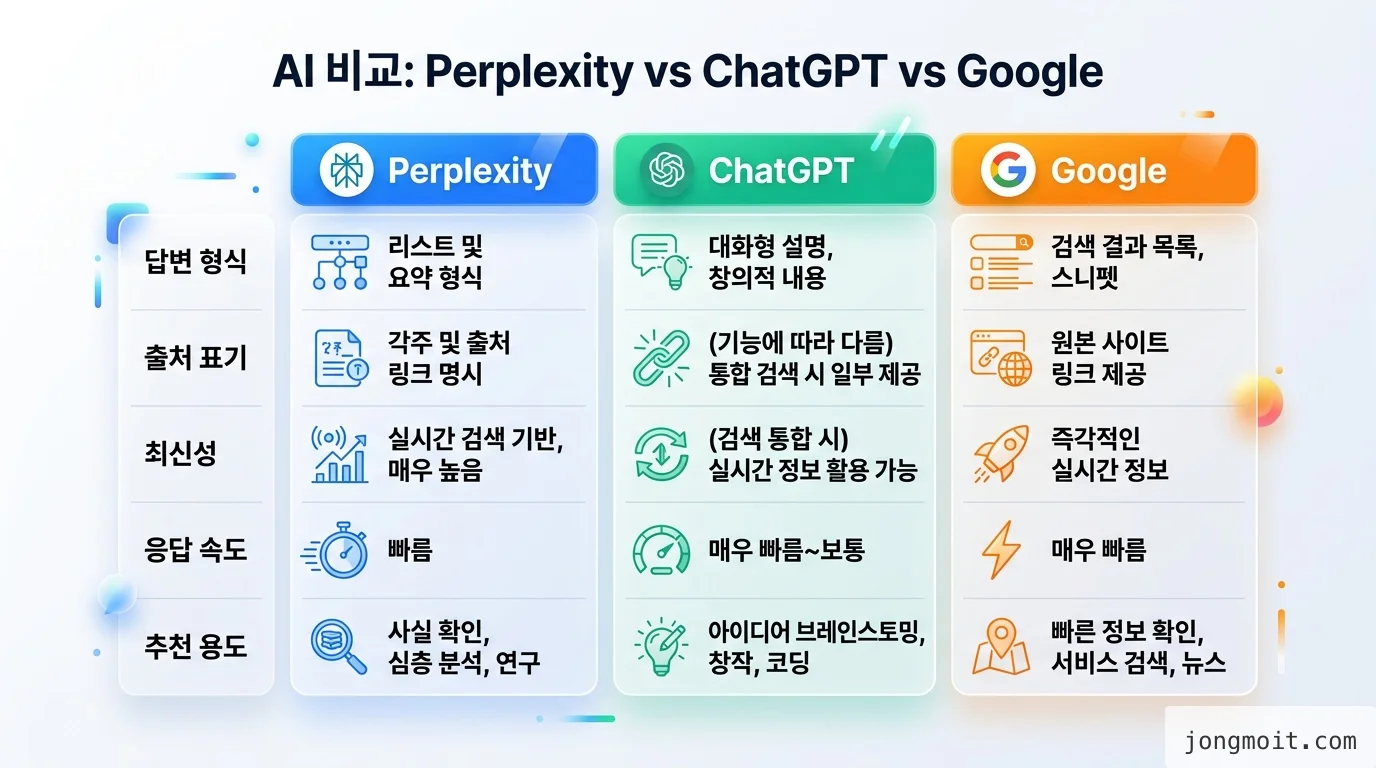

- 같은 질문 3개를 ChatGPT·구글·Perplexity에 직접 넣어 본 비교 결과 정리

- 무료 플랜으로도 일반 사용자는 충분, Pro($20)는 Pro Search 300+회/일과 다중 모델 선택이 본전

- Focus 모드(Academic·YouTube·Reddit·Math) 활용 시점과 실무 시나리오

- 인용 할루시네이션 37% — Perplexity도 거짓 인용을 만든다, 검증 루틴 5단계 필수

ChatGPT를 매일 쓰면서도 보고서나 메모에 인용을 붙여야 할 때마다 결국 구글로 돌아가 출처를 다시 찾는 분, 많을 거예요. 저도 그랬습니다.

지난 3개월간 Perplexity AI 사용법을 본격적으로 익히면서 같은 질문 30여 개를 ChatGPT·구글·Perplexity에 넣고 답변과 출처를 비교했어요. 결론부터 말하면, 검색·검증 단계는 Perplexity로 옮겨도 되고, 작성·요약은 여전히 ChatGPT가 강합니다. 이 글에서는 그 비교 결과와 함께 무료/Pro 결정 기준, Focus 모드 활용법, 그리고 가장 중요한 — 인용 할루시네이션 37%를 어떻게 줄이는지까지 직접 정리한 운영 가이드를 공유합니다.

Target Environment

- Perplexity 웹/모바일 (2026년 5월 기준)

- 비교 대상: ChatGPT Plus ($20/월), Google 검색

- 사용 모델: Sonar Pro, GPT-5.5, Claude Opus 4.7 (Perplexity Pro 내장)

🤔 ChatGPT만 쓰면 놓치는 것들 — Perplexity AI 사용법이 필요한 이유

직장에서 AI를 쓸 때 가장 자주 마주치는 곤란한 순간은 "그래서 그 숫자, 출처가 뭐예요?"라는 질문입니다. ChatGPT가 알려준 통계를 그대로 옮겼다가 회의 자리에서 출처가 막히면 신뢰가 크게 깎이죠.

Perplexity AI 사용법의 핵심은 단 하나로 요약됩니다. 답변 옆에 인용이 같이 붙어 나온다는 것. 이게 ChatGPT 단독 사용과의 결정적 차이고, 직장인 워크플로우를 바꾸는 지점이에요.

📊 데이터: Perplexity는 실시간 웹 검색 후 응답을 합성하기 때문에, 답변 정확도가 종합 94%, 학술 95%, 기술 분야 94% 수준으로 측정된다는 datastudios.org 비교 분석 결과가 있어요.

Perplexity는 '검색+AI', ChatGPT는 'AI 단독'

기술적으로 둘은 완전히 다른 카테고리입니다.

- ChatGPT: 거대 언어 모델(LLM)이 학습 데이터 + 내장 웹 검색을 활용해 대화·창작·코드 작성에 강점

- Perplexity: 검색 엔진을 AI가 감싼 형태(RAG 구조). 모든 답변이 실시간 웹 결과를 기반으로 생성

같은 "GPT-5"라는 단어를 넣어도, ChatGPT는 자신의 학습 시점 정보로 설명을 늘어놓는 반면 Perplexity는 오늘자 발표 자료부터 가져옵니다. 보고서에 "최신 자료에 따르면"이라고 쓰려면 후자 쪽이 훨씬 안전해요.

30대 직장인이 Perplexity를 써봐야 하는 3가지 시점

다음 상황 중 하나에라도 해당된다면 Perplexity AI 사용법을 익혀두는 게 좋아요.

- 회의·보고서에 통계나 시장 데이터 인용이 자주 필요할 때

- 법령·규정·약관처럼 최신성과 출처 검증이 중요한 정보 조사

- 시장 조사: 경쟁사·신제품 동향을 빠르게 훑어야 할 때

📌 핵심: 창작·요약·코드 작성은 ChatGPT, 출처가 필요한 검색·검증은 Perplexity — 이 분업이 2026년 직장인 AI 워크플로우의 표준이에요.

⚖️ Step 1: Perplexity vs ChatGPT vs 구글 — 같은 질문 3개로 비교했다

말로만 다르다고 하면 와닿지 않으니 실제 비교 결과를 보여드릴게요. 직접 같은 질문 3개를 동시에 넣어보고 답변·출처·소요 시간을 기록했습니다.

시나리오 1: "2026년 한국 노트북 시장 점유율 1위 브랜드는?"

- ChatGPT (GPT-5.5): "최근 추세로는 삼성과 LG가 강세이며…"라며 모호한 답변. 출처 없음

- Perplexity (Sonar Pro): 한국갤럽·IDC 코리아 보고서 4건을 인용하며 구체적 점유율 제시. 보고서 링크 클릭 시 원문 확인 가능

- 구글 검색: 상위 5개 링크 표시, 사용자가 직접 종합해야 함. 시간 5〜7분 소요

회의 자료를 만들 때는 출처를 그대로 발췌해 인용까지 붙여야 하므로 Perplexity가 압도적으로 유리했어요.

시나리오 2: "Node.js 24 LTS와 22 LTS의 성능 차이가 궁금해"

- ChatGPT: 일반론 + 자체 추정. 벤치마크 수치 없음

- Perplexity: V8 공식 블로그·OpenJS Foundation 발표·Hacker News 토론 인용. 실제 버전별 벤치마크 그래프 링크 제공

- 구글: 공식 블로그 링크는 제공하지만 Hacker News 같은 커뮤니티 의견은 별도 검색 필요

기술 의사결정에서 출처가 곧 신뢰도이기 때문에, 이런 질문에는 Perplexity 쪽이 훨씬 효율적이었습니다.

시나리오 3: "이메일 회신 문구 좀 정중하게 다듬어줘"

- ChatGPT: 3가지 톤(정중·간결·친근)으로 즉시 변형 제공. 매끄러움 우수

- Perplexity: 답변은 가능하지만 굳이 검색이 필요 없는 작업이라 결과가 다소 딱딱함

- 구글: 영역 밖

💡 팁: 글쓰기·번역·요약·코드 작성처럼 '검색'이 필요 없는 작업은 ChatGPT 쪽이 훨씬 자연스러워요. Perplexity는 RAG 특성상 검색 결과에 답변이 묶여, 창작 자유도가 낮습니다.

결론: 같은 질문이라도 도구가 다르다

3개 시나리오를 정리하면 다음과 같아요.

| 작업 유형 | 추천 도구 |

|---|---|

| 시장·통계·법령·뉴스 검색 | Perplexity |

| 보고서 인용·출처 확보 | Perplexity |

| 글쓰기·요약·번역·아이디어 발산 | ChatGPT |

| 코드 작성·디버깅 | ChatGPT (보조: Perplexity로 라이브러리 최신 이슈 확인) |

| 단순 사이트 탐색 | 구글 |

Zapier의 Perplexity vs ChatGPT 2026 비교 글에서도 동일한 결론을 내리고 있어요 — "검색·검증은 Perplexity, 창작·실행은 ChatGPT"라는 분업 워크플로우가 2026년 표준이라는 거예요.

💎 Step 2: 무료 vs Pro($20) — 어떤 사람이 결제해야 본전인가

Perplexity 결제 화면을 처음 보면 헷갈리는 게 무료와 Pro의 차이가 한눈에 와닿지 않는다는 거예요. 직접 두 플랜을 한 달씩 써보고 정리한 차이점은 다음과 같습니다.

무료 플랜으로 충분한 경우

- 하루 2〜5회 정도 가벼운 검색만 사용

- 답변 모델을 따로 고를 필요 없음 (기본 Sonar로 충분)

- 첨부 파일 분석을 거의 안 함

- 회의록·보고서에 인용을 붙이는 빈도가 주 1〜2회 이하

이 경우라면 무료 플랜으로 충분합니다. 답변 정확도가 떨어지는 게 아니라, 단지 Pro Search 횟수와 모델 선택권이 제한될 뿐이에요.

Pro($20/월)가 본전 뽑는 사람

- Pro Search 300+회/일: 깊이 있는 멀티스텝 검색이 필요한 마케터·기획자·연구자

- 다중 LLM 선택: GPT-5.5, Claude Opus 4.7, Gemini 3.1, Sonar Pro 중 골라서 비교 가능

- 첨부 파일 무제한: PDF·CSV 업로드 후 검색·요약을 자주 함

- Spaces 무제한: 프로젝트별 협업 워크스페이스 운영

특히 PDF·CSV 분석을 자주 한다면 Pro가 빠르게 본전을 뽑습니다. 50페이지짜리 IR 보고서를 업로드하고 "매출 추이 핵심만 정리해줘"를 던지는 사용 패턴이 잡히면 무료 플랜으로는 답답해요.

⚠️ 주의: 학생·연구자라면 Education Pro $5/월 (SheerID 인증 시 50% 할인)이 따로 있어요. ChatGPT Plus($20)보다 훨씬 저렴하면서도 동일한 Pro 기능을 모두 사용할 수 있습니다.

Pro와 ChatGPT Plus를 동시에 쓰는 게 합리적일까?

저는 결과적으로 둘 다 결제했어요. 월 40달러는 부담스러울 수 있지만, 분업이 명확해진 뒤로 매주 절약되는 검증 시간을 환산하면 본전 이상이었습니다. 다만 다음 조건이라면 둘 중 하나만 써도 됩니다.

- 검색·인용보다 창작·코드가 비중이 크다 → ChatGPT만

- 보고서·시장 조사가 비중이 크다 → Perplexity만

- 둘 다 적당하다 → Perplexity Pro 단일 가입으로 GPT-5.5·Claude까지 다 써보는 게 효율적

📌 핵심: Perplexity Pro 안에서 GPT-5.5, Claude Opus 4.7, Gemini 3.1을 다 골라 쓸 수 있어요. 모델별 답변 차이가 궁금한 사람에겐 Perplexity Pro가 단일 결제로 가장 합리적입니다.

FindSkill.ai 2026 AI 가격 비교에서도 "다중 모델 접근성을 기준으로 단일 결제 가성비는 Perplexity Pro가 우위"라고 평가하고 있어요.

📎 Step 3: 출처 자동 인용 기능, 실무 활용 시나리오 5가지

Perplexity AI 사용법의 진짜 매력은 답변 끝에 자동으로 달리는 인용 카드입니다. 이걸 어떻게 실무에 녹이느냐가 결국 도구 활용도를 결정해요.

시나리오 1. 보고서·기획서에 통계 인용

질문 예: "2026년 글로벌 SaaS 시장 규모와 성장률 추이는?"

답변과 함께 Statista·Gartner·McKinsey 보고서 링크가 뜹니다. 인용 번호를 클릭하면 해당 페이지의 정확한 위치까지 표시되는 경우가 많아, 보고서 본문에 "Statista 2026 보고서에 따르면 글로벌 SaaS 시장은 ~"이라는 문장을 그대로 옮길 수 있어요.

시나리오 2. 시장 조사 — 경쟁사 동향

질문 예: "최근 3개월간 OpenAI와 Anthropic이 발표한 주요 기능 비교"

각 사 공식 블로그·뉴스룸·기사 링크를 모아주기 때문에 별도 RSS 구독 없이도 동향 파악이 빠릅니다. 보통 같은 작업을 구글·뉴스·블로그에서 별도로 하면 30분 걸리는데, Perplexity로는 5분이면 끝나요.

시나리오 3. 학술 리서치 (Academic Focus)

질문 예: "직장인 번아웃과 원격근무의 상관관계 연구"

Academic Focus 모드를 켜면 Semantic Scholar의 2억+ 학술 논문 데이터베이스 안에서만 답변을 합성합니다. 일반 검색으로는 묻히는 peer-reviewed 자료를 손쉽게 찾을 수 있어요.

시나리오 4. 제품 도입 검증

질문 예: "n8n과 Make 비교, 엔터프라이즈에서의 실제 단점은?"

Reddit Focus 모드와 일반 모드를 같이 쓰면, 공식 마케팅 자료(일반)와 실제 사용자 후기(Reddit)를 한 번에 비교할 수 있어요. 의사결정 전에 "포장된 정보 vs 솔직한 후기"의 균형을 빠르게 잡을 수 있습니다.

시나리오 5. 법령·규정 확인

질문 예: "2026년 한국 부가가치세 신고 마감일과 연장 사유"

국세청·법령정보센터 같은 공식 출처가 우선 노출됩니다. 다만 법령·세무는 YMYL 영역이라 Perplexity 답변을 100% 신뢰하지 말고, 인용된 공식 사이트 원문을 반드시 한 번 더 확인해야 해요.

💡 팁: 인용 카드 위에 마우스를 올리면 미리보기가 뜹니다. 클릭 전에 출처가 신뢰할 만한 곳인지 한 번 거르는 습관을 들이면, 나중에 보고서를 검토받을 때 출처 신뢰도 문제가 거의 없습니다.

🎯 Step 4: Focus 모드 — 학술·YouTube·Reddit·Math 언제 쓰나

Perplexity의 Focus 모드는 검색 범위를 제한해서 답변 신뢰도를 끌어올리는 기능이에요. 2026년 5월 기준 사용 가능한 주요 모드는 다음과 같습니다.

| 모드 | 검색 범위 | 추천 사용처 |

|---|---|---|

| All | 전체 웹 | 일반적인 질문, 출처 종류 무관 |

| Academic | Semantic Scholar (peer-reviewed 논문) | 학술 리서치, 의학·심리학·경제학 근거 |

| Writing | 사전·문법 자료 | 영작·번역·문장 다듬기 |

| YouTube | YouTube 자막·메타데이터 | 강의·튜토리얼 요약, 영상 콘텐츠 검색 |

| Reddit 토론·댓글 | 솔직한 사용자 후기, 커뮤니티 의견 | |

| Math | Wolfram Alpha 통합 | 수학 계산, 단위 변환 |

Academic 모드 — 보고서·논문 인용에 강함

대학원생·연구원 외에도 직장인 마케터에게 의외로 유용해요. "고객 충성도 형성 메커니즘에 대한 연구"처럼 비즈니스 인사이트를 학술 근거로 보강하고 싶을 때 일반 모드는 블로그·기사 위주로 답변하지만, Academic 모드는 SCI급 저널 논문을 먼저 찾아줍니다.

YouTube 모드 — 긴 강의 영상 빠르게 훑기

"Andrej Karpathy의 LLM 강의에서 강조한 핵심 3가지" 같은 질문을 던지면, 영상 자막을 분석해 핵심 타임스탬프와 함께 요약을 줘요. 1시간짜리 강의를 다 볼 시간 없을 때 매우 유용합니다.

Reddit 모드 — 마케팅·B2B 의사결정에 강함

"Notion vs Obsidian 실제 사용자 만족도 후기"처럼 공식 마케팅 자료가 아닌 진짜 후기가 필요한 상황에서 진가를 발휘합니다. 단, Reddit 답변은 개인 의견이 섞여 있으니 인용 시 "Reddit 사용자 의견 중 ~"라는 식으로 출처 성격을 명시해야 해요.

Spaces — 모드보다 한 단계 위의 워크스페이스

Focus 모드와 별개로 Spaces라는 협업 워크스페이스 기능이 있어요. 프로젝트마다 Space를 만들어 두고:

- 커스텀 인스트럭션을 미리 설정 (예: "한국 시장 자료만, 2024년 이후만")

- 관련 PDF·CSV 파일을 미리 업로드

- 같은 Space 안에서 모든 검색이 위 조건 + 첨부 자료를 기반으로 작동

저는 시장 조사 프로젝트마다 Space를 만들어 운영하고 있는데, 매번 똑같은 컨텍스트를 다시 입력할 필요가 없어 시간 절약이 큽니다. 자세한 운영법은 Perplexity 공식 가이드를 한 번 정독하면 좋아요.

📌 핵심: Focus 모드는 한 번 검색의 정확도, Spaces는 한 프로젝트의 일관성을 끌어올려요. 단발성 질문은 Focus, 반복 작업은 Spaces로 나누어 쓰세요.

⚠️ 주의사항: 인용 할루시네이션 37%, 검증 루틴 5단계

Perplexity AI 사용법에서 가장 중요한 건 사실 '주의사항' 영역입니다. 답변에 출처가 붙는다고 해서 100% 신뢰할 수 있는 게 아니에요.

📊 데이터: GPTZero의 Perplexity 인용 조사에 따르면 Perplexity Sonar Pro는 인용 정확도(citation accuracy) 기준 할루시네이션 37%를 기록했습니다. 응답 자체의 사실 정확도는 90%대지만, 인용된 URL이 실제로 그 주장을 담고 있는지는 또 다른 문제예요.

쉽게 말해 "URL은 진짜이지만, 그 URL의 내용이 답변과 다른 경우"가 3건 중 1건은 발생할 수 있다는 거예요. 보고서에 그대로 옮기면 출처 검증 단계에서 신뢰도가 무너집니다.

흔한 실수 1. 인용 카드만 보고 클릭 안 함

가장 많이 하는 실수예요. 답변 옆에 출처가 떠 있다고 안심하고, 정작 클릭해서 원문을 확인하지 않으면 잘못된 인용을 그대로 옮기게 됩니다.

흔한 실수 2. Reddit·블로그 출처를 공식 자료처럼 인용

Perplexity는 Reddit 게시글·개인 블로그도 출처로 활용합니다. 보고서에 인용할 때는 출처 종류를 반드시 분류해야 해요. 공식 보도자료, 공식 통계, 학술 논문, 커뮤니티 의견은 신뢰도 등급이 달라요.

흔한 실수 3. 한국어 질문에 영어 자료 위주 답변

영어권 자료가 압도적으로 많기 때문에, 한국 시장·법령·통계가 필요한 경우엔 답변이 부정확할 수 있어요. 질문에 "한국 자료만", "국내 통계 우선"이라고 명시하거나, 한국어 키워드로 별도 검색을 한 번 더 해야 합니다.

인용 할루시네이션을 줄이는 검증 루틴 5단계

저는 보고서·기획서에 Perplexity 답변을 옮길 때 다음 5단계를 무조건 거칩니다.

- 수치·고유명사 추출: 답변에서 옮길 수치·인명·기관명·날짜를 모두 표시

- 인용 클릭: 해당 수치 옆 인용 번호를 클릭, 원문 페이지로 이동

- 원문에 그 수치가 있는지 확인 (Ctrl+F로 정확한 단어 검색)

- 출처 종류 분류: 공식 보도자료/통계/학술 논문/블로그/Reddit으로 신뢰도 등급 표시

- 2개 이상 출처 교차 검증: 동일 수치를 다른 출처에서도 확인

이 루틴을 거치는 데 1〜2분이 추가되지만, 보고서가 검토받을 때 출처 신뢰도 문제로 다시 작업할 일이 거의 없어졌어요.

⚠️ 주의: 의료·법률·세무·금융 등 YMYL(Your Money Your Life) 영역에서는 Perplexity 답변을 절대 단독으로 신뢰하지 마세요. 반드시 공식 사이트 원문 또는 전문가 확인을 거쳐야 합니다.

✅ 마무리: '검색을 인용 가능한 근거로 바꾸는 도구'

Perplexity AI 사용법을 한 줄로 요약하면 이렇습니다 — "검색 결과를 그대로 인용 가능한 형태로 바꿔주는 도구". ChatGPT가 잘하는 영역과 겹치지 않고, 직장인 워크플로우에서 명확한 빈자리를 채워줍니다.

처음 30일 추천 워크플로우

- 1주차: 평소 ChatGPT에 던지던 질문 중 '출처가 있어야 하는 것'만 Perplexity로 옮겨봄

- 2주차: Focus 모드(특히 Academic, Reddit) 의도적으로 사용

- 3주차: Spaces 1개 만들어 진행 중인 프로젝트 컨텍스트 적재

- 4주차: 무료/Pro 결정 — 1주차 사용량과 PDF 분석 빈도 기반

30대 직장인이 가장 먼저 시도해 볼 것

회의 자료에 들어갈 시장 통계 1개, 경쟁사 동향 1개를 Perplexity로 뽑아 위 검증 루틴 5단계까지 거쳐보세요. 한 번만 해보면 차이가 즉시 느껴질 거예요.

다른 AI 도구 비교가 궁금하다면 코파일럿 활용법 가이드나 Notion vs Obsidian 비교 글도 함께 읽어보시면 좋습니다.

🔍 Root Cause: 왜 LLM 단독은 최신 정보를 다룰 수 없는가

LLM이 최신 정보를 못 다루는 이유는 단순히 "학습 데이터가 오래돼서"가 아닙니다. 본질적인 원인은 추론 시점에 외부 지식 접근이 없기 때문이에요.

학습 컷오프와 가중치 동결

GPT-5.5의 학습 데이터 컷오프는 2025년 후반입니다. 학습이 끝난 모델 가중치(weights)는 추론 시 변하지 않아요. 즉, 2026년 5월에 발표된 신제품 정보는 모델이 본 적이 없습니다. 그래서 ChatGPT에 "이번 주 발표된 GPT-5.5 신기능"을 물으면 학습 데이터 안의 비슷한 내용을 그럴듯하게 합성해 답변을 만들어냅니다.

내장 웹 검색의 한계

ChatGPT도 2024년부터 내장 웹 검색을 지원하지만, 검색은 어디까지나 보조 기능입니다. 답변 생성 파이프라인의 주체가 LLM이기 때문에, 검색 결과를 가져와도 모델이 자체 학습 지식과 충돌할 때 학습 지식이 우선되는 경향이 있어요. 그래서 ChatGPT의 답변에는 출처가 자주 누락됩니다.

Perplexity의 RAG 구조

Perplexity는 반대로 검색이 주체입니다. 사용자 질문이 들어오면:

- 먼저 검색 엔진이 관련 문서 N개를 가져옴

- 그 문서들을 LLM에 컨텍스트로 주입

- LLM은 주입된 문서 안에서만 답변을 생성하고, 각 문장의 출처를 표시

이게 RAG(Retrieval-Augmented Generation)의 기본 구조이고, 답변에 인용이 자동으로 붙는 이유예요.

⚙️ Engineering Rationale: RAG가 검색을 다시 정의한 이유

RAG는 단순히 "AI에 검색 기능을 붙인 것"이 아니라, 정보 시스템 설계 패러다임을 바꾼 아키텍처입니다. 시니어 엔지니어 관점에서 RAG를 선택할 때 고려하는 트레이드오프를 정리하면 다음과 같아요.

장점: 환각 감소 + 출처 추적성

- LLM 단독 응답은 "그럴듯하지만 틀린 답"을 만들 위험이 큼

- RAG는 "검색된 문서 안에서만 합성"하므로 답변 근거가 명시적

- 답변 검증·디버깅·재현이 가능해짐 — 운영 환경에서 중요한 특성

한계: 검색 품질이 답변 품질을 결정

- 검색 단계에서 누락된 문서는 답변에서도 누락됨

- 동일한 주제를 다룬 문서가 여러 개일 때, 검색 랭킹이 답변 품질을 좌우

- Perplexity가 인용 할루시네이션 37%를 기록한 것도 이 한계와 관련 있음 — 가져온 문서를 LLM이 합성하는 과정에서 잘못 매칭

대안 비교

| 아키텍처 | 출처 추적 | 최신성 | 창작 자유도 |

|---|---|---|---|

| LLM 단독 (ChatGPT) | 약함 | 학습 컷오프 기준 | 강함 |

| LLM + 검색 보조 (ChatGPT 웹) | 보통 | 실시간 | 강함 |

| RAG (Perplexity) | 강함 | 실시간 | 보통 |

| LLM + 도구 호출 (Claude Skills) | 강함 | 실시간 | 강함 |

이런 차이가 결국 "어떤 작업에 어떤 도구를 쓸지"를 결정하는 기준이 돼요.

🚀 Optimization Point: 답변 정확도를 끌어올리는 프롬프트 패턴

같은 Perplexity AI 사용법이라도 프롬프트 작성 패턴에 따라 답변 품질이 크게 달라집니다. 운영하면서 효과가 컸던 패턴 4가지만 정리해 둘게요.

패턴 1. 출처 종류를 명시

❌ "원격근무가 생산성에 미치는 영향은?"

✅ "원격근무가 생산성에 미치는 영향에 대한 2024년 이후 학술 논문 3편을 인용해서 답변해줘"

검색 결과의 종류를 명시하면 답변에 사용되는 출처의 신뢰도 등급이 통제됩니다.

패턴 2. 직접 인용 요청

❌ "그래서 결론이 뭐야?"

✅ "결론을 원문에서 직접 인용한 문장으로 보여줘"

LLM이 합성하는 과정에서 의역이 일어나 사실이 왜곡되는 걸 막을 수 있어요. natesnewsletter.substack.com의 Perplexity 할루시네이션 방지 가이드에서도 동일한 패턴을 핵심 전략으로 제시합니다.

패턴 3. 모델과 추론을 분리

❌ "이게 사실이야?"

✅ "'문서가 명시한 사실'과 '네가 추론한 부분'을 분리해서 답변해줘"

답변에서 모델 추론 부분을 명시적으로 분리하면, 어디까지가 출처 기반이고 어디부터가 추정인지 즉시 확인할 수 있어요.

패턴 4. 반대 의견 동시 검색

❌ "이 제품 어때?"

✅ "이 제품의 장점과 단점을 동시에, 각각 출처 2개씩 인용해서 정리해줘"

긍정적 후기만 모아주는 검색 편향을 막을 수 있습니다.